Tecnología

¿Usaste ChatGPT en tus solicitudes escolares? Estas palabras pueden alertar sobre su empleo

ChatGPT y otras IA generativas se están utilizando ampliamente en la educación superior en las admisiones escolares. Pero ahora, los estudiantes que han recurrido a la IA para escribir están recurriendo a las personas para hacer que ese trabajo parezca más humano.

“Tapiz.” “Faro.” “Plan de estudios integral”. “Estimado profesorado”. “Comunidad académica vibrante”, son palabras que se encuentran entre la larga lista de términos coloridos, frases floridas y sintaxis obsoleta que probablemente avisen a los comités de admisiones de los solicitantes que han utilizado la IA para ayudar a escribir sus ensayos universitarios o de posgrado este año, según los consultores de ensayos que son los estudiantes. contratando en masa para eliminar ChatGPT y agregar un “toque humano” a sus envíos.

“Tapiz” en particular es una importante señal de alerta en el grupo de este año, dijeron a Forbes varios consultores de ensayos en la plataforma Fiverr. Mike, un alumno de la Ivy League y ex editor en jefe del Cornell Business Journal que ahora edita cientos de solicitudes de posgrado en cada ciclo a través de Capitol Editors, dijo que ha aparecido repetidamente en borradores de al menos 20 de sus clientes en los últimos meses. (Solicitó el anonimato para proteger su privacidad).

“Ya no creo que haya una manera de usar inocentemente la palabra ‘tapiz’ en un ensayo; si aparece la palabra ‘tapiz’, fue generada por ChatGPT”, dijo a Forbes. Aunque muchas palabras así, por sí solas, podrían haber provienen de un ser humano, cuando un ojo entrenado ve que se usan una y otra vez con la misma cadencia en múltiples ensayos, “es simplemente una señal realmente reveladora”.

“Habrá un ajuste de cuentas”, añadió Mike. “Habrá un montón de estudiantes que, sin saberlo, utilicen la palabra ‘tapiz’ u otras palabras en su ensayo que [pueden] no ser admitidas en este ciclo”.

Este invierno y primavera marcan la primera temporada de admisiones completa desde la explosión y la amplia adopción de ChatGPT y otras IA generativas, y en el mundo de la educación, los casos de uso de rápido crecimiento de la tecnología han superado con creces las políticas escolares. Algunos educadores están tratando de defenderse de la tecnología con políticas de “tolerancia cero”, mientras que otros la adoptan activamente en sus aulas (la Universidad Estatal de Arizona, por ejemplo, se está asociando con OpenAI para utilizar ChatGPT Enterprise para tutorías y cursos). Pero a falta de reglas cohesivas y consistentes sobre cómo se puede utilizar la IA en el proceso de solicitud, en todo caso, y sin herramientas que puedan detectar de manera confiable si se ha utilizado, muchos estudiantes han recurrido a ChatGPT de OpenAI y sus rivales en busca de ayuda. La adopción ha dado lugar a una industria artesanal de consultores independientes que se especializan en eliminar la jerga sospechosa de la IA y hacer que los ensayos parezcan auténticos.

Forbes preguntó a más de 20 universidades públicas y privadas de diversos tamaños en los Estados Unidos, desde Arizona State y Georgia Tech hasta Princeton y Harvard, sobre las tendencias en el uso de AI o ChatGPT entre las aplicaciones y cómo están manejando a los candidatos que probablemente hayan confiado en él. Muchas escuelas se negaron a hacer comentarios o no respondieron; La portavoz de Emory, Sylvia Carson, dijo que “es demasiado pronto para que nuestra gente de admisiones ofrezca observaciones claras”.

“YA NO CREO QUE HAYA UNA MANERA DE UTILIZAR INOCENTEMENTE LA PALABRA ‘TAPIZ’ EN UN ENSAYO; SI APARECE LA PALABRA ‘TAPIZ’, FUE GENERADA POR CHATGPT”.

Mike, consultor de ensayos y ex editor en jefe de Cornell Business Journal

Pero los consultores de edición dijeron a Forbes que si pudieran detectar el uso sospechoso de IA después de leer solo docenas o cientos de ensayos, a los comités de admisiones que revisen muchos más les podría resultar aún más fácil detectar estos patrones. Ben Toll, decano de admisiones de pregrado de la Universidad George Washington, explicó lo fácil que es para los funcionarios de admisiones detectar solicitudes escritas por IA.

“Cuando has leído miles de ensayos a lo largo de los años, los ensayos influenciados por la IA destacan”, dijo Toll a Forbes. “Es posible que no den señales de alerta al lector ocasional, pero desde el punto de vista de la revisión de una solicitud de admisión, a menudo son ineficaces y una oportunidad perdida para el estudiante”.

De hecho, el personal de admisiones de GWU se capacitó este año con ensayos de muestra que incluían uno escrito con la ayuda de ChatGPT, dijo Toll, y un miembro del comité tardó menos de un minuto en detectarlo.

¿Usaste ChatGPT en tus solicitudes escolares? Estas palabras pueden alertar sobre su empleo

Las palabras eran “delgadas, huecas y planas”, dijo. “Si bien el ensayo llenó la página y respondió a la pregunta, no le brindó al equipo de admisiones ninguna información para ayudar a que la solicitud avanzara hacia una decisión de admisión”. (Divulgación: una de las autoras del artículo, Alexandra, ocasionalmente ha compartido comentarios con solicitantes universitarios sobre sus ensayos).

UNA DEMANDA DE “VIBRACIONES HUMANAS”

En diciembre de 2023, apareció una solicitud inusual en la cuenta Fiverr de Indiana Pejic: “¿Podrías editar y corregir mi declaración personal, 1,000 palabras? Lo escribí en parte con ChatGPT y agradecería que pudieras hacerlo sonar menos robótico”. La solicitud era de un estudiante coreano que solicitaba un doctorado en literatura renacentista en la Universidad de Cambridge.

Pejic, un profesional independiente en Serbia que tiene tres maestrías y un doctorado, ha editado aproximadamente 100 declaraciones personales y ensayos universitarios a través de Fiverr. Aunque inicialmente temía que su negocio se viera afectado con la aparición de ChatGPT, la realidad ha sido todo lo contrario: el auge de la IA ha impulsado una demanda sin precedentes de editores expertos en hacer que la escritura generada por computadora suene como algo real. “ChatGPT tiene muchas palabras”, dijo, y “hay muchas palabras abstractas que realmente no conectan bien”. Hoy en día, cobra hasta 100 dólares por añadir “vibraciones humanas” a los ensayos escritos por IA. (Otros que ofrecen servicios similares a través de Fiverr cobran entre 10 y 150 dólares, dependiendo de la duración).

Lara Cantos, editora y traductora en México, dijo que ha visto tantos grupos repetitivos de palabras y construcciones de oraciones que ha elaborado un glosario de términos que activaron las alarmas de la IA. “Es la terminología específica y la estructura de las oraciones las que comienzan a repetirse, y el uso de los mismos adjetivos una y otra vez”, dijo. (“Tapiz”, señaló, también hace apariciones recurrentes).

“LO ESCRIBÍ EN PARTE CON CHATGPT Y AGRADECERÍA QUE PUDIERAS HACERLO SONAR MENOS ROBÓTICO”.

Un estudiante que solicita un doctorado en la Universidad de Cambridge.

Mike, de Capitol Editors, dice que él también ha mantenido una lista actualizada. Incluye describir algo que “se alinea perfectamente con mis aspiraciones” o “deriva de una pasión profundamente arraigada”, o hace referencia a la “destreza de liderazgo”, el “viaje empresarial/educativo” y el “compromiso con la mejora y la innovación continuas”. (Una estructura que es reveladora, añadió, es “no simplemente X, sino Y”, o “no solo X, sino Y”).

Todos los consultores con los que habló Forbes dijeron que las herramientas de inteligencia artificial son bastante populares entre los estudiantes internacionales que solicitan admisión en el extranjero y que recurren a ChatGPT porque el inglés no es su primer idioma. En algunos casos, alimentarán las ideas de la IA o le darán indicaciones en su idioma nativo para comenzar con un primer borrador; en otros, dependerán más de la tecnología. “Acabo de recibir un pedido de un estudiante en Suiza que solicita ingresar a los EE. UU. con un ensayo generado por ChatGPT”, dijo Cantos a Forbes. “Parte del contenido escrito por IA parece una traducción literal”.

UN SALVAJE OESTE DE EDUCACIÓN SUPERIOR

Si bien las herramientas de inteligencia artificial que pueden escribir y refinar grandes bloques de texto continúan desarrollándose a una velocidad vertiginosa, volviéndose mejores en escritura y más difíciles de detectar, las escuelas luchan por mantenerse al día y llegar a un consenso sobre cómo abordarlas en las aplicaciones. Y, mientras tanto, los estudiantes buscan políticas más claras (y superan los límites) sobre lo que pueden y no pueden hacer con estas herramientas.

“No creo que haya nada que se acerque a un enfoque consistente del problema”, dijo Chris Reed, director ejecutivo de admisiones de Texas A&M.

Cada oficina de admisiones tiene reglas diferentes sobre el uso de la IA en las solicitudes, que van desde la estricta política de “tolerancia cero” de la Universidad del Sur de California hasta la posición de Georgia Tech de que los estudiantes pueden usar la IA como un “colaborador útil” y la postura de Texas A&M de que los solicitantes pueden enviar contenido generado por IA porque la universidad ha dejado de utilizar el ensayo universitario estándar como muestra de escritura. (De hecho, uno de los motivos del programa de honores de Texas A&M es utilizar una plataforma de inteligencia artificial como ChatGPT o Bard de Google para escribir un ensayo y luego criticar qué tan bien pudo presentar un argumento).

“Gran parte depende de cada institución individual y de cómo utilizan los ensayos en su proceso”, dijo Reed de Texas A&M, señalando que alrededor del 30% de los ensayos de admisión que reciben ahora utilizan IA de alguna manera según la detección de IA. herramienta GPTZero.

Otras universidades son menos flexibles. En la Universidad de California, que tiene 10 campus en todo el estado, los futuros estudiantes pueden utilizar la IA para realizar una lluvia de ideas y crear un esquema, pero el borrador final debe estar “escrito de forma independiente” y las respuestas que incluyan una “respuesta de IA sin editar” (como una copiar y pegar directamente desde ChatGPT) podría marcarse como plagio, dijo la portavoz Rachel Zaentz a Forbes en un correo electrónico. “Sería más trabajo para [los solicitantes] intentar crear un mensaje ChatGPT sólido que desarrollar sus propias respuestas originales a las preguntas”, agregó.

La Solicitud Común, utilizada por más de un millón de estudiantes cada año para postularse a más de 1,000 instituciones académicas, también considera “el contenido sustancial o el resultado de una plataforma de inteligencia artificial” una forma de plagio según su política de fraude. La presidenta de Common App, Jenny Rickard, dijo a Forbes que “investigamos todas las acusaciones de fraude y, si están fundamentadas, tomamos las medidas disciplinarias adecuadas”. No dijo cómo se investigan exactamente los posibles casos de plagio relacionado con la IA, aunque señaló que la aplicación común no utiliza herramientas de detección de IA. Sin embargo, las consecuencias pueden ser graves y las acciones disciplinarias incluyen informar los hallazgos a todos los miembros de la compañía. universidades en la lista “Mis universidades” de un estudiante.

LA DETECCIÓN, UNA CIENCIA IMPERFECTA

No es de extrañar que Common App no dependa de herramientas que prometen eliminar el contenido generado por IA: sigue siendo notoriamente inexacta, hasta el punto de que OpenAI cerró su propio software de detección de IA. Líderes en el espacio como GPTZero han cambiado de rumbo y ahora ofrecen a las escuelas análisis de alto nivel sobre cómo se utiliza la IA en las aplicaciones en lugar de identificar ensayos problemáticos. Otros creadores de software de detección han advertido contra el uso de la tecnología en las admisiones.

LAS ACCIONES DISCIPLINARIAS POR EL USO DE IA EN THE COMMON APPLICATION INCLUYEN INFORMAR LOS HALLAZGOS A TODAS LAS UNIVERSIDADES MIEMBROS EN LA LISTA “MIS UNIVERSIDADES” DE UN ESTUDIANTE.

Jenny Rickard, directora ejecutiva y presidenta de Common App

Eric Mitchell, un estudiante de doctorado en Stanford que creó DetectGPT, lo llamó “un campo minado total”, advirtiendo que si bien la investigación sobre software de detección vale la pena, las herramientas resultantes simplemente no están listas para el horario de máxima audiencia en la educación superior. La admisión a la universidad es un momento tan crítico en la vida de una persona, dijo en una entrevista, y “el costo de condenar falsamente el ensayo de alguien es tan alto, [que] no estoy seguro de que podamos aceptar una tasa de falsos positivos del 2%. No está claro en qué medida las escuelas utilizan este software en las admisiones”, pero tanto Mitchell como el director ejecutivo de GPTZero, Edward Tian, dijeron que los educadores han expresado interés.

Como la mayoría de las escuelas con las que Forbes contactó para esta historia, el decano de admisiones universitarias de GWU no dijo si las herramientas de detección de IA son parte de su proceso de revisión. Pero sí defendió a los aspirantes a asistentes para que evitaran ChatGPT y sus pares por completo.

“Cuando un estudiante completa su solicitud, la mayoría de los materiales ya habrán sido solidificados. Los solicitantes no pueden cambiar sus calificaciones. No pueden retroceder en el tiempo y cambiar las actividades en las que han estado involucrados”, dijo Toll. “Pero el ensayo es el único lugar donde mantienen el control hasta el momento en que presionan enviar la solicitud. Quiero que los estudiantes comprendan cuánto valoramos conocerlos a través de sus escritos y cómo herramientas como la IA generativa terminan quitando su voz de su solicitud de admisión”.

Con información de Forbes

JE

Tecnología

Cómo puedo desactivar el buzón de voz de mi celular

¿Cansado de las notificaciones por el buzón de voz? Te decimos cómo desactivar esta función en tu smartphone.

Con el avance de la tecnología y la creciente popularidad de las aplicaciones de mensajería, muchas personas han encontrado que el buzón de voz ya no es tan útil como solía serlo. Además, la acumulación de notificaciones puede convertirse en una molestia.

Qué es el buzón de voz

El buzón de voz es una función de los teléfonos móviles que permite a los usuarios recibir y almacenar mensajes de voz cuando no pueden contestar una llamada. Actúa como un sistema de contestador automático, permitiendo a los llamantes dejar mensajes que el destinatario puede escuchar posteriormente.

Desactivar buzón de voz en iOS

- Abre la aplicación de teléfono.

- Marca #004#

- Podrás ver un mensaje de desactivación de esta función.

- Para finalizar da clic en cerrar.

Y en Android

- Abre la aplicación teléfono.

- Marca ##002#.

- Automáticamente, se desactivará el buzón de voz.

Desviar todas las llamadas al buzón de voz en Android

En ocasiones, nos vemos ocupados con tareas de trabajo o estudio, lo que nos lleva a activar el modo avión para evitar distracciones. Sin embargo, esta acción también desactiva la señal de wifi. Para quienes desean evitar recibir llamadas, existe una solución sencilla: marcar **21*242#. Esto enviará todas las llamadas al buzón sin interrumpir la conexión a internet. Para desactivar esta función, simplemente marca ##21#.

Con información de Expansión

JE

Tecnología

¿Quieres aprender Excel? La UNAM ofrece curso certificado gratis

La UNAM, a través de la Coordinación de la Universidad Abierta y Educación a Distancia (CUAED) ha lanzado el curso virtual con certificado “Herramientas básicas de Microsoft office Excel”.

La herramienta de Excel ha sido una aliada en la mayoría de las profesiones, y hoy en día es casi obligatorio su dominio para casi cualquier empleo.

Pero si eres de lo que aún quiere perfeccionar su uso, tienes que saber que la UNAM, a través de la Coordinación de la Universidad Abierta y Educación a Distancia (CUAED) ofrecerá el curso virtual con certificado “Herramientas básicas de Microsoft office Excel” , el cual se encuentra alojado en la plataforma Aprendo+.

El curso a cargo del Ingeniero Jonathan Martínez Razo, permite conocer los elementos básicos que integran las funciones de Excel, y tiene por objetivo el aprender a utilizar hojas de cálculo y funciones, gráficos para organizar y planear actividades, entre muchísimas otras herramientas, además de poner a disposición recursos como videos e imágenes que hacen más dinámica la enseñanza.

El curso virtual tiene una duración de 30 horas y se compone de siete unidades, las cuales se desglosan de la siguiente manera:

Unidad 1: Iniciando con Excel.

Unidad 2: Ambiente de trabajo y conceptos básicos;

- Barra de título,

- Cinta o banda de opciones

- Barra de desplazamiento

- Barra de fórmulas.

Unidad 3: Administración y manejo de libros, hojas y celdas.

Unidad 4: Autocompletado.

Unidad 5: Fórmulas y funciones básicas.

- Función suma

- Función promedio

- Función moda.

Unidad 6: Gráficos

Unidad 7: Impresión.

Aquí todo lo que debes de saber para inscribirte:

Para inscribirte deberás registrarte previamente. En la plataforma encontrarás un catálogo con todos los cursos disponibles, por lo que se debe hacer una búsqueda con la palabra “Excel” para que se muestre el curso.

Enlace al curso: puedes inscribirte entrando al curso “Herramientas básicas de Microsoft office Excel”

Con información de MVS Noticias

JE

Tecnología

Microsoft está probando un agente animado con IA para soporte en Xbox

El chatbot de Xbox con IA estará conectado a los documentos de soporte de Microsoft y al ecosistema de la consola, y puede responder preguntas e incluso procesar reembolsos de juegos.

El gigante tecnológico Microsoft está probando un nuevo agente animado con inteligencia artificial (IA) en Xbox para dar soporte a los jugadores, según informa este martes el medio especializado The Verge.

“Estamos probando un agente virtual de soporte, un prototipo interno de un personaje animado que puede consultar temas de soporte de Xbox con voz o texto”, dijo Haiyan Zhang, gerente general de IA de juegos en Xbox, en un comunicado a The Verge.

De acuerdo con Zhang, este prototipo hará que sea “más fácil y rápido” para los jugadores obtener ayuda con temas de soporte.

Con información de Forbes

JE

-

Espectáculoshace 10 horas

Espectáculoshace 10 horasJosé Eduardo revela por qué no invitó a Victoria Ruffo a su ‘baby shower’: “Fue solamente de los Derbez”

-

Rosaritohace 2 días

Rosaritohace 2 díasFotos| Caballos provocan carambola en la carretera escénica Tijuana – Ensenada

-

Policíacahace 2 días

Policíacahace 2 díasTras asalto con violencia dos sujetos fueron detenidos en Tijuana 👊🤕

-

Políticahace 10 horas

Políticahace 10 horasMorena pide protección, por cuestión extraordinaria, para 40 candidatos en Guanajuato

-

Políticahace 2 días

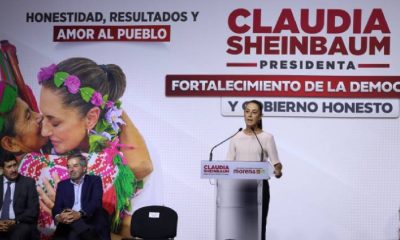

Políticahace 2 días¿Qué propone Sheinbaum para combatir la corrupción? Su plan de 10 puntos

-

Internacionalhace 2 días

Internacionalhace 2 díasTrump asegura que ‘no le daría ni 10 centavos’ a la propuesta migratoria de AMLO

-

Méxicohace 2 días

Méxicohace 2 díasPortal del SAT para declaración anual inicia abril con fallas

-

Méxicohace 2 días

Méxicohace 2 díasCaso Camila: Confirman orden de aprehensión contra presuntos responsables de feminicidio